دوره 26، شماره 4 - ( زمستان 1404 )

دوره، شماره، فصل و سال، شماره مسلسل |

برگشت به فهرست نسخه ها

Download citation:

BibTeX | RIS | EndNote | Medlars | ProCite | Reference Manager | RefWorks

Send citation to:

BibTeX | RIS | EndNote | Medlars | ProCite | Reference Manager | RefWorks

Send citation to:

Taheri Afshar M, Eshaghzadeh M, Nadi A, Poursadeghian M, Rajabzadeh M. The Ethical Dilemmas of Artificial Intelligence In Nursing: A Systematic Review. jrehab 2026; 26 (4) :490-509

URL: http://rehabilitationj.uswr.ac.ir/article-1-3626-fa.html

URL: http://rehabilitationj.uswr.ac.ir/article-1-3626-fa.html

طاهری افشار مژده، اسحاق زاده ملیحه، نادی امیرحسین، پور صادقیان محسن، رجب زاده مصطفی. مروری نظاممند بر دوراهی اخلاقی هوش مصنوعی در پرستاری. مجله توانبخشی. 1404; 26 (4) :490-509

URL: http://rehabilitationj.uswr.ac.ir/article-1-3626-fa.html

1- کمیته تحقیقات دانشجویی، دانشکده پرستاری و مامایی فاطمه زهرا (س) رامسر، پژوهشکده سلامت، دانشگاه علوم پزشکی بابل، بابل، ایران.

2- گروه پرستاری، دانشکده پرستاری و مامایی، دانشگاه علوم پزشکی تربت حیدریه، تربت حیدریه، ایران.

3- گروه پرستاری، کمیته تحقیقات دانشجویی، دانشگاه علوم پزشکی تربت حیدریه، تربت حیدریه، ایران.

4- مرکز تحقیقات عوامل اجتماعی موثر بر سلامت، دانشگاه علوم پزشکی اردبیل، اردبیل، ایران. ،poursadeghiyan@gmail.com

5- کمیته تحقیقات دانشجویی، دانشکده پرستاری و مامایی، دانشگاه علوم پزشکی تربت حیدریه، تربت حیدریه، ایران.

2- گروه پرستاری، دانشکده پرستاری و مامایی، دانشگاه علوم پزشکی تربت حیدریه، تربت حیدریه، ایران.

3- گروه پرستاری، کمیته تحقیقات دانشجویی، دانشگاه علوم پزشکی تربت حیدریه، تربت حیدریه، ایران.

4- مرکز تحقیقات عوامل اجتماعی موثر بر سلامت، دانشگاه علوم پزشکی اردبیل، اردبیل، ایران. ،

5- کمیته تحقیقات دانشجویی، دانشکده پرستاری و مامایی، دانشگاه علوم پزشکی تربت حیدریه، تربت حیدریه، ایران.

متن کامل [PDF 3847 kb]

(81 دریافت)

| چکیده (HTML) (2164 مشاهده)

جدولبندی و خلاصه کردن اطلاعات و دادهها

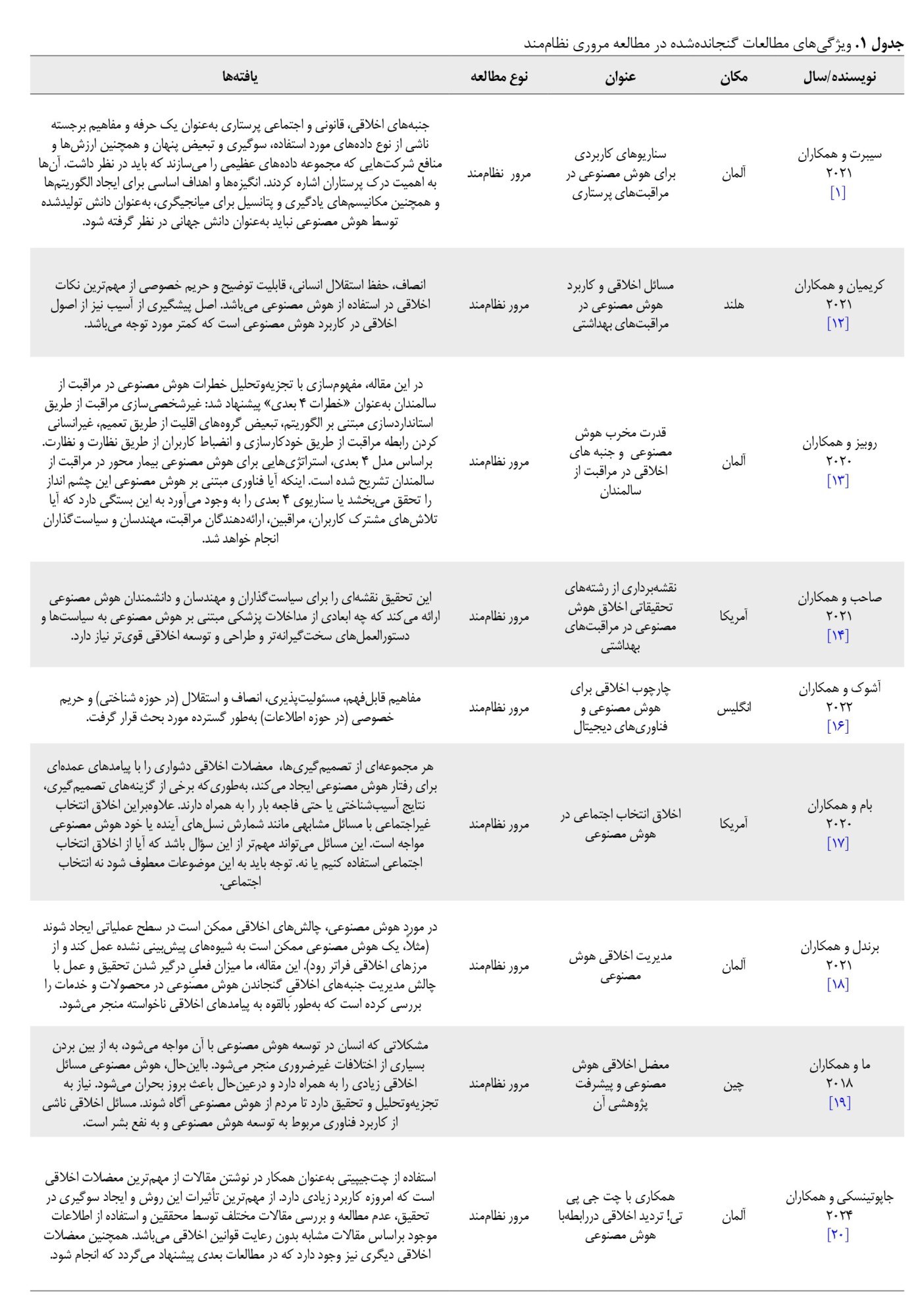

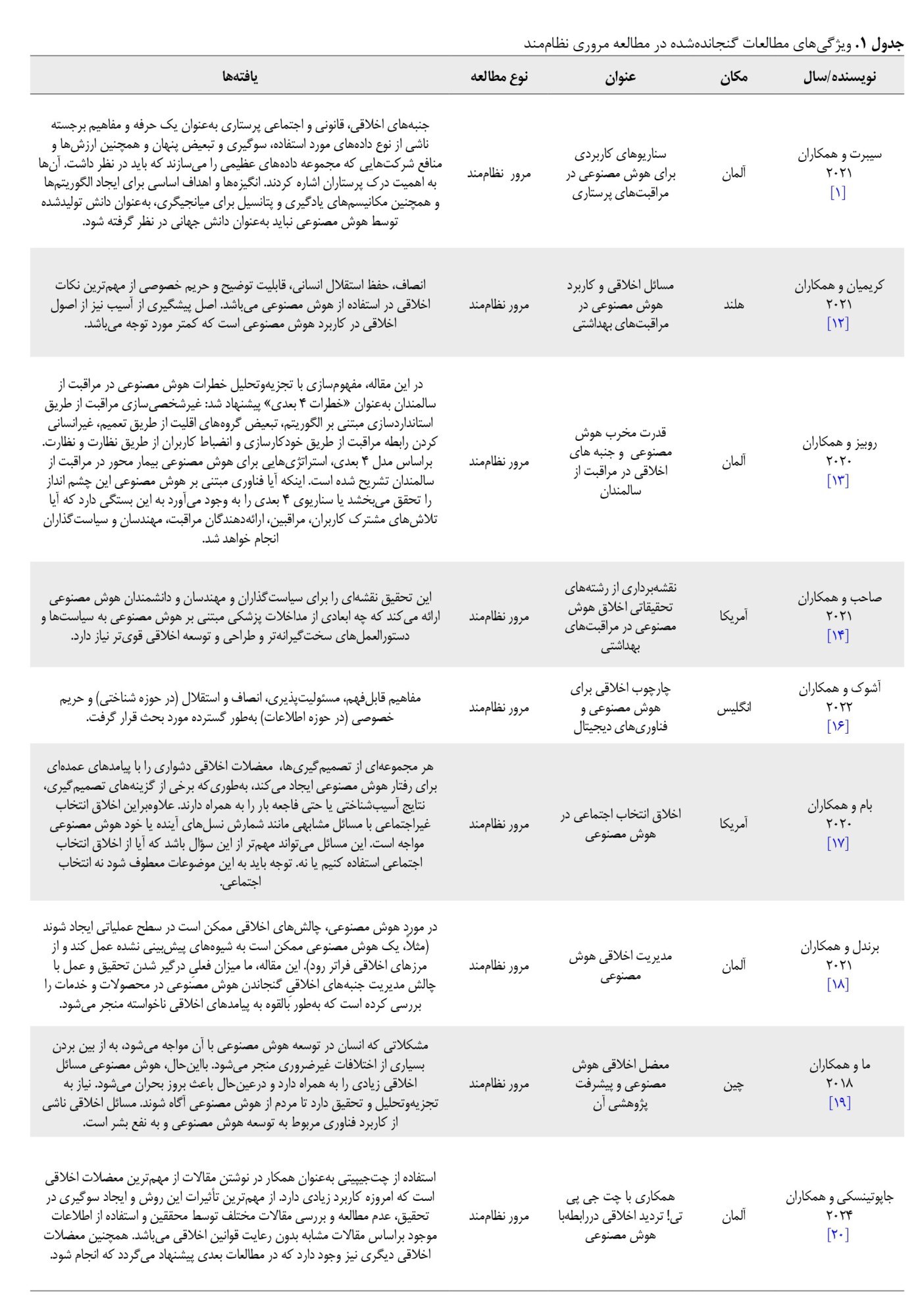

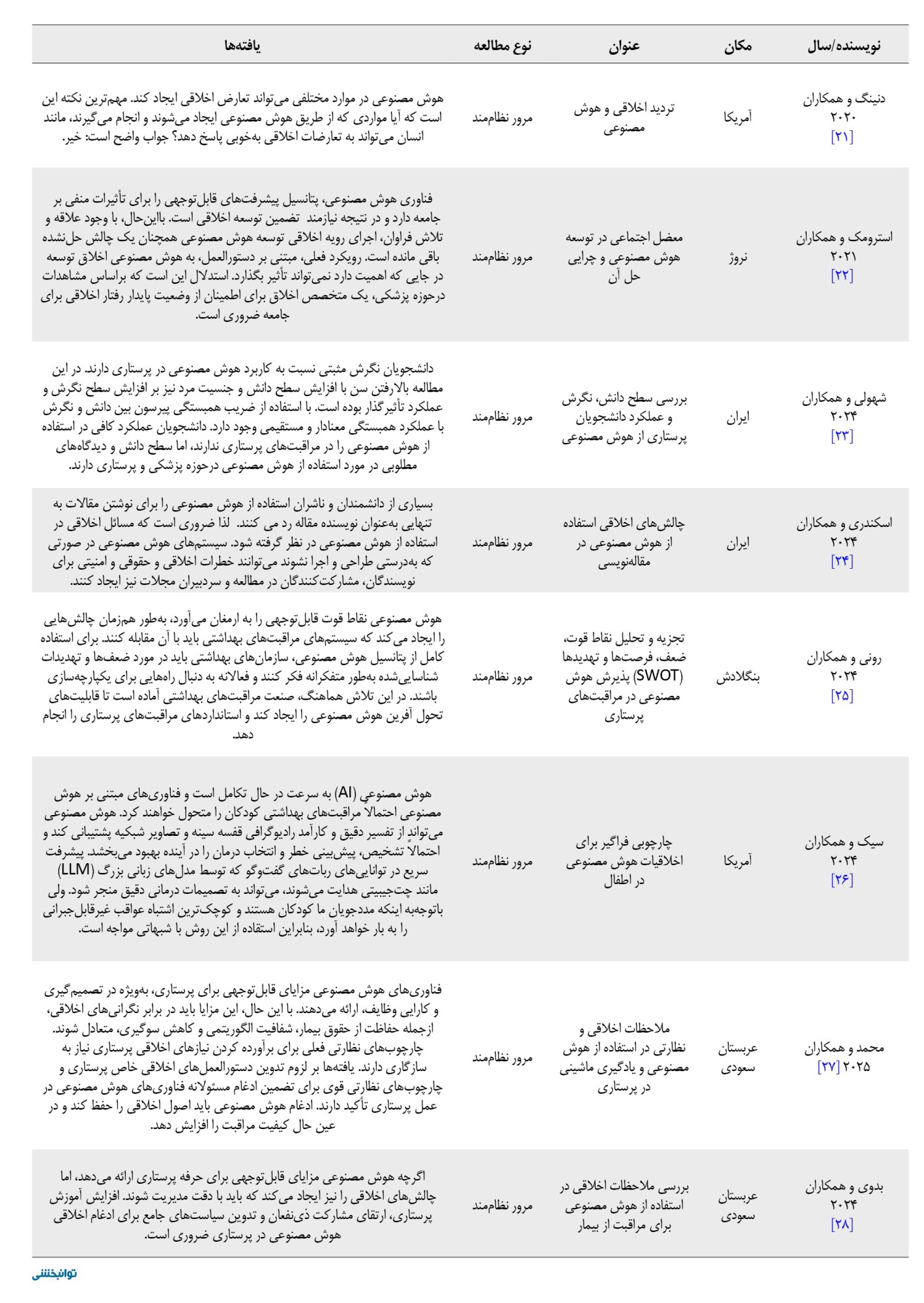

در این مرحله پس از اینکه دادهها استخراج گردید، کلیه دادههای مطالعات براساس نام نویسنده اول، سال، مکان، عنوان و یافتههای پژوهش در جدول شماره 1 خلاصه شد.

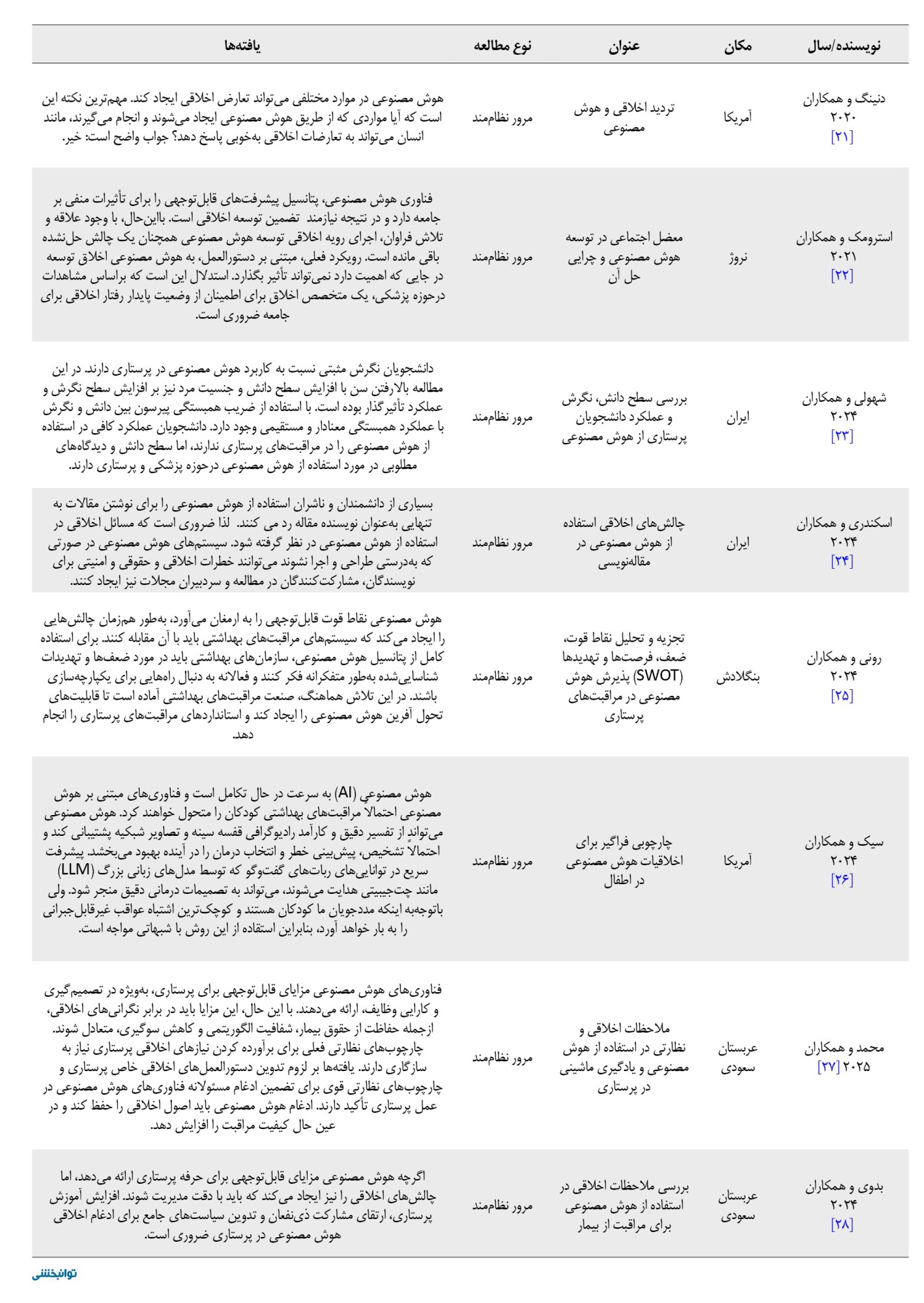

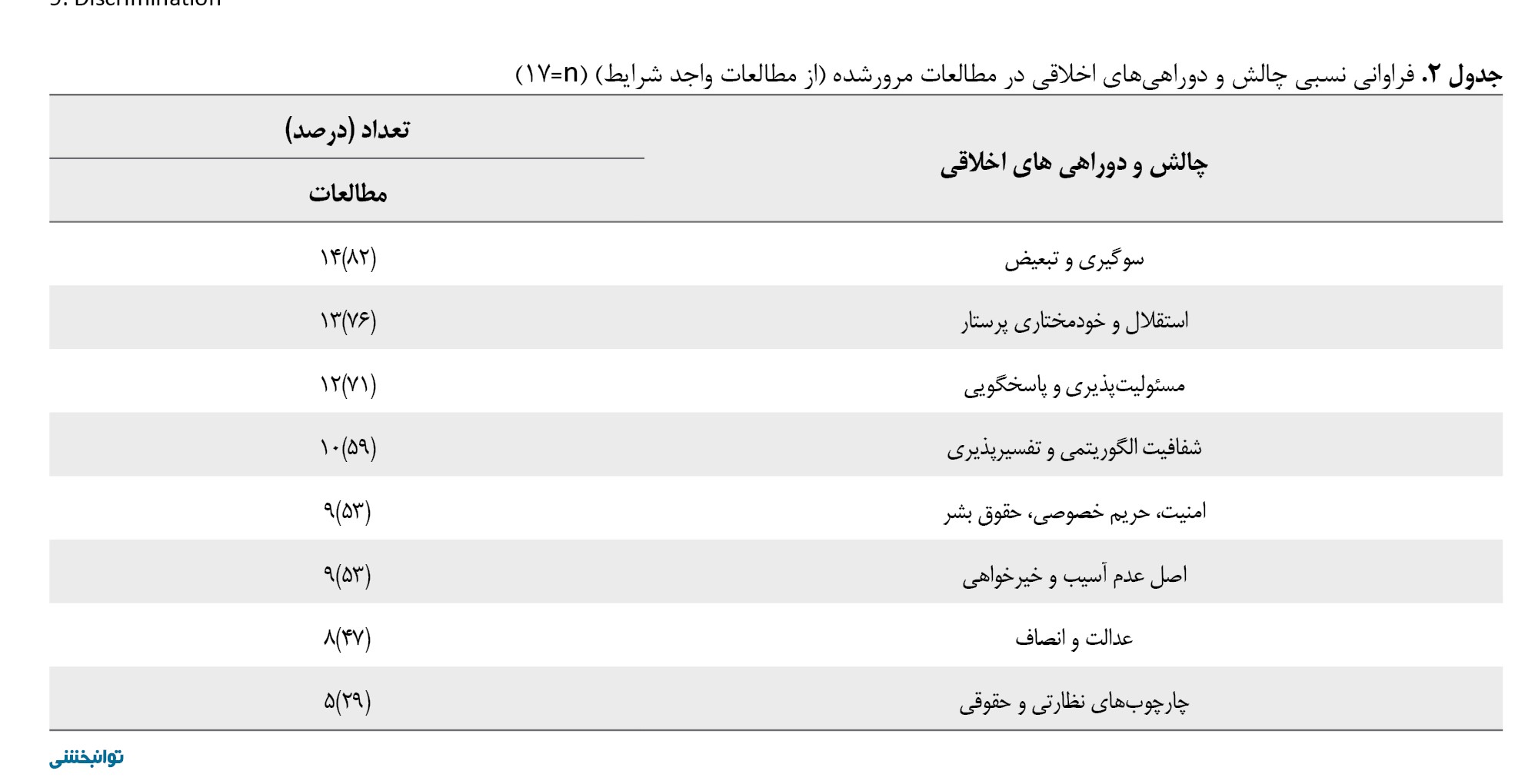

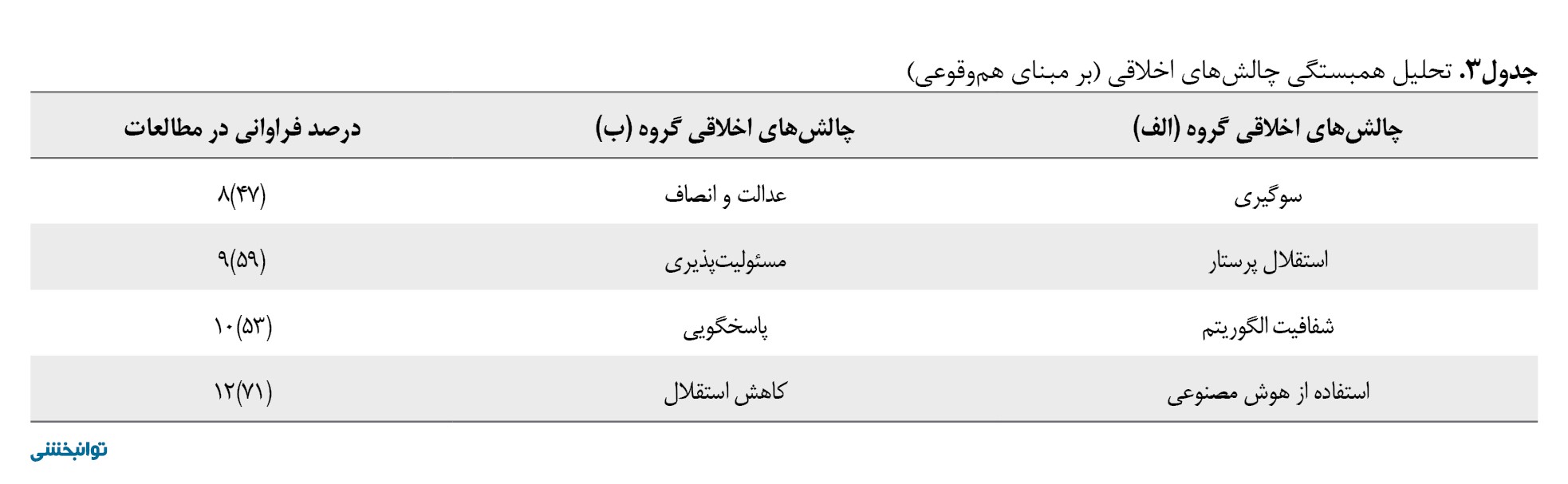

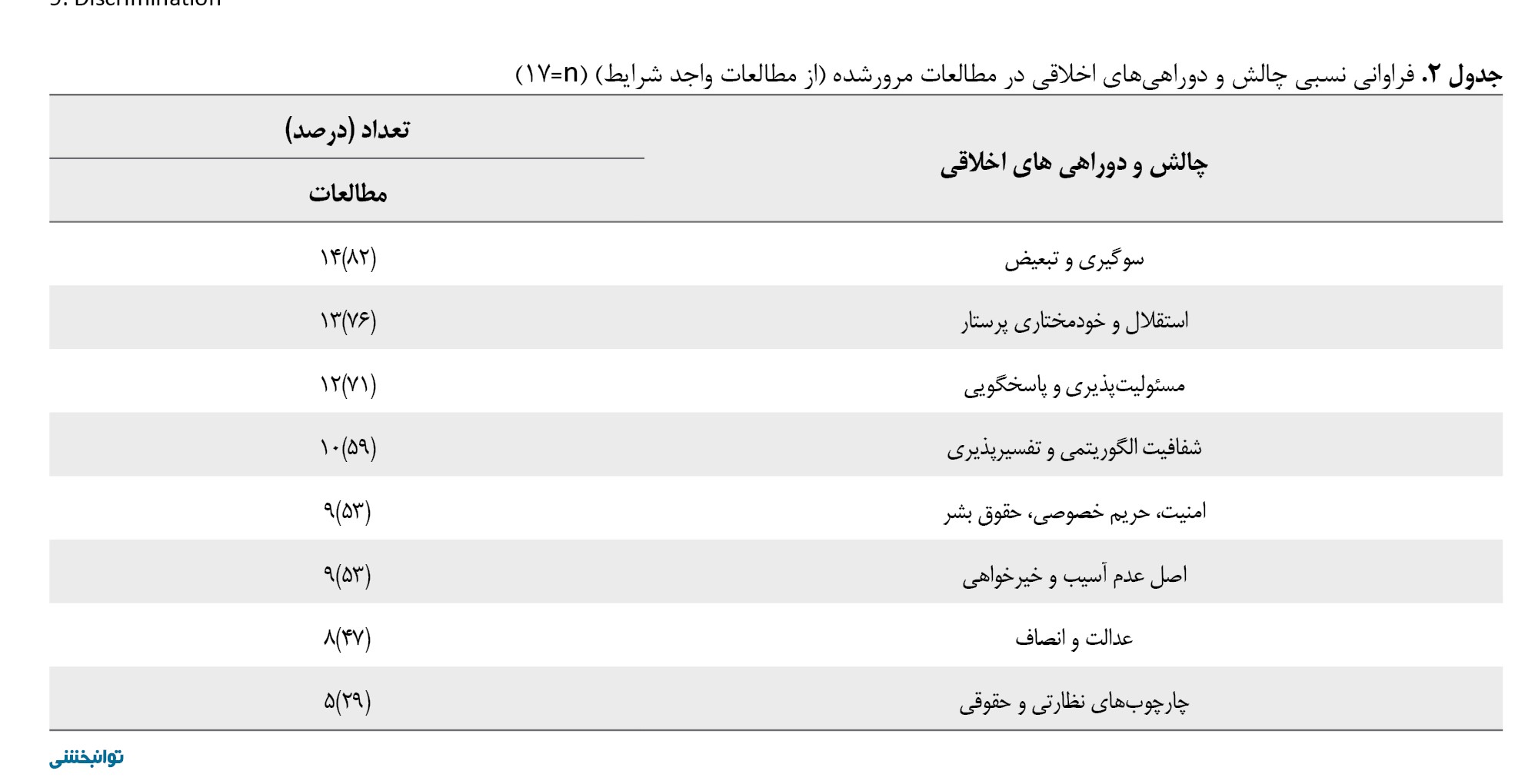

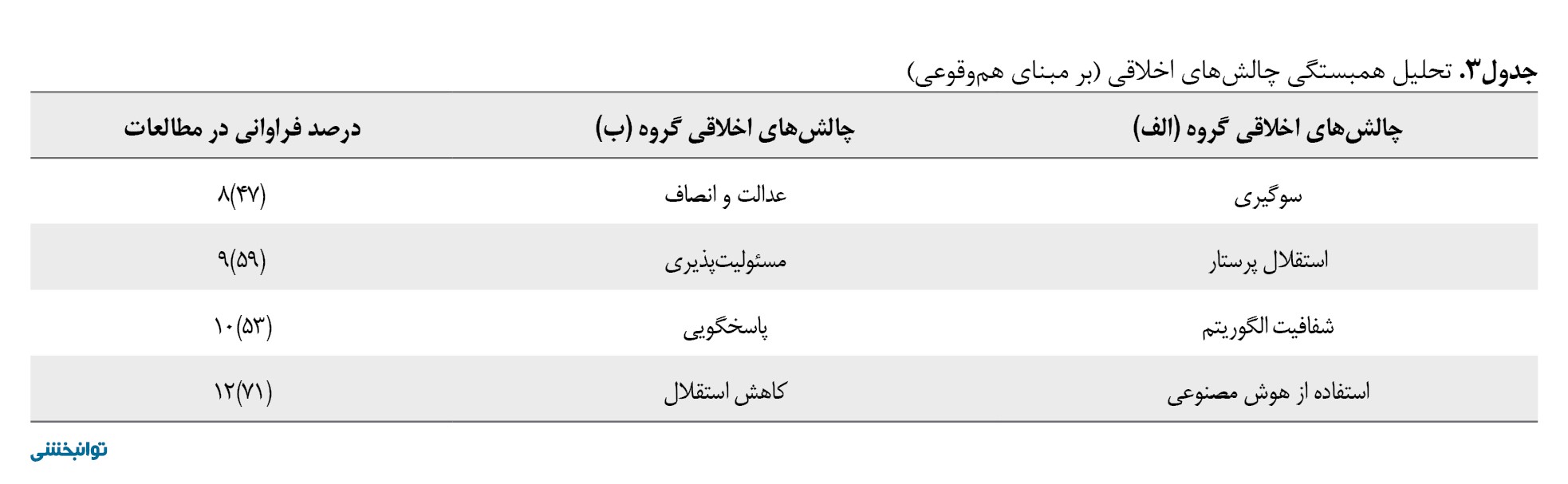

همچنین در جدول شماره 2 فراوانی نسبی چالش و دوراهیهای اخلاقی در مطالعات مرورشده و جدول شماره 3 تحلیل همبستگی چالشهای اخلاقی (بر مبنای هموقوعی) آورده شده است.

گزارش نتایج

پس از مطالعه خلاصه و متن کامل مقالات مرتبط با موضوع تحقیق اطلاعات موردنظر برای انجام نگارش استخراج شد. اطلاعات لازم برای هر مطالعه شامل نام نویسنده، سال، مکان، نوع مطالعه، روش نمونهگیری، ابزار گردآوری اطلاعات و نتایج بود. در انتها، اطلاعات حاصل از مقالات طبقهبندی شد و در نهایت بهصورت متن کامل یک مقاله مروری گزارش شد.

یافتهها

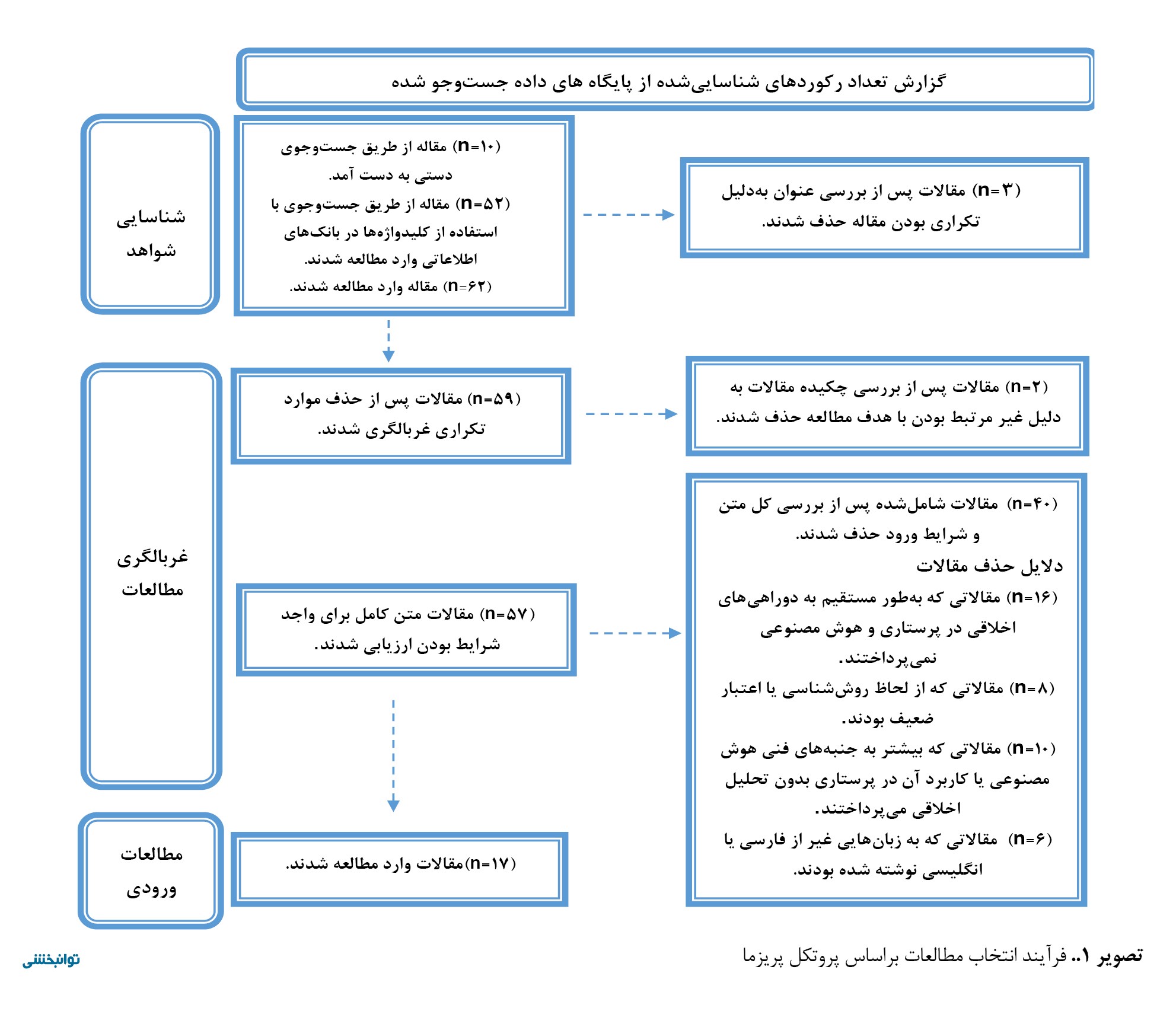

در مجموع، 62 مطالعه از پایگاهها بازیابی شدند. پس از بررسی مقالات براساس عنوان و چکیده، 10 مقاله غیرمرتبط حذف شدند. از 52 مقاله باقیمانده، پس از بررسی متن کامل آنها، در نهایت 17 مطالعه واجد شرایط ورود به مرور بودند (تصویر شماره 1) . فرآیند انتخاب مطالعات براساس پروتکل پریزما انجام شد و مشخصات مطالعات واردشده به مرور در جدول شماره 1 نشان داده شده است. استفاده از هوش مصنوعی در مراقبتهای سلامت، چالشهای اخلاقی متعددی را به همراه دارد که باید مدنظر قرار گیرند.

استفاده از هوش مصنوعی در مراقبتهای سلامت ممکن است بر استقلال بیمار تأثیر بگذارد و نیاز به اطمینان از مشارکت بیمار در فرآیند تصمیمگیریهای مراقبتی وجود دارد. هوش مصنوعی در عمل با چالشهای فوری در یکپارچهسازی با مسائل بالینی مواجه است، ازجمله اینکه چگونه با اخذ رضایت آگاهانه هماهنگ شود. در استفاده از هوش مصنوعی در مراقبتهای سلامت، نیاز به ایمنی، شفافیت و وضوح در دستورالعملها و مقررات وجود دارد. استفاده از هوش مصنوعی در مراقبتهای سلامت شامل جمعآوری دادههای شخصی و حساس است که باید از حملات سایبری محافظت شود و حریم خصوصی اطلاعات بیماران حفظ گردد. توسعه و استفاده از هوش مصنوعی در مراقبتهای سلامت نیازمند پاسخگویی بهموقع و شفافیت است.

استفاده از هوش مصنوعی در مراقبتهای سلامت، علیرغم مزایای متعدد، محدودیتها و چالشهای اخلاقی متعددی را به همراه دارد که باید به آنها پرداخته شود، ازجمله رضایت آگاهانه، ایمنی و وضوح دستورالعملها، حریم خصوصی دادههای مرتبط با بیمار، پاسخگویی و تأثیر بر استقلال بیمار. ایجاد دستورالعملها و مقررات واضح برای تضمین توسعه و پیادهسازی هوش مصنوعی به روشی اخلاقی و پاسخگو دارای اهمیت است. در جدول شماره 1، این موضوع بهصورت دقیق بررسی شده است.

بحث

این مطالعه با بررسی دقیق 17 مقاله مرتبط، به واکاوی چالشهای اخلاقی ناشی از بهکارگیری هوش مصنوعی (AI) در حوزه پرستاری پرداخته است. یافتههای ما بهوضوح نشان میدهند که ورود هوش مصنوعی به عرصه مراقبتهای پرستاری، مجموعهای از دوراهیهای اخلاقی را برای پرستاران ایجاد میکند که میتواند بر روند تصمیمگیری و عملکرد آنها در موقعیتهای حساس بالینی تأثیرگذار باشد. این تردیدها و چالشها صرفاً جنبه نظری ندارند، بلکه ریشه در ماهیت تکنولوژیهای هوش مصنوعی و کاربرد آنها در محیطهای پیچیده مراقبت سلامت دارند.

یافتههای این مطالعه نشان داد استفاده از هوش مصنوعی میتواند چالشهای اخلاقی متعددی ایجاد کند و پرستاران را در مسیر دوراهی و تردید در انتخاب و عملکرد دررابطهبا مسائل اخلاقی جهت انجام امور مراقبتی قرار دهد. تاآنجاکه مطالعات مختلفی در این زمینه انجام شده و مسائل اخلاقی را تجزیهوتحلیل کردهاند، پیشرفتهای اخیر در زمینه هوش مصنوعی در سلامت و مراقبت، با برخی مسائل اخلاقی همراه است. چالشهایی دررابطهبا سوگیری، تبعیض، عدم شفافیت، نگرانیهای منطقی یا ناهنجاریها وجود دارد.

یکی از مهمترین چالشها، مسئله سوگیری (Bias) در الگوریتمهای هوش مصنوعی است. الگوریتمها براساس دادههایی آموزش میبینند که ممکن است خود شامل سوگیریهای تاریخی، فرهنگی یا اجتماعی باشند. این سوگیریها میتوانند منجر به تبعیض در ارائه مراقبتها شوند؛ برایمثال، توصیههای هوش مصنوعی ممکن است برای گروههای خاصی از بیماران (مانند اقلیتهای قومی یا بیماران با وضعیت اقتصادی-اجتماعی پایین) کمتر دقیق یا حتی مضر باشند. علاوهبراین، سؤالهای مختلفی وجود دارد که سعی میکنند به مسائلی نظیر اجازه تعامل یا مداخله هوش مصنوعی و اینکه آیا سیستمها باید حمایتکننده یا تصمیمگیر باشند، پاسخ دهند. اگرچه هوش مصنوعی بهطور مکرر در مراقبتهای پرستاری میتواند مورد استفاده قرار گیرد، باید از منظر اخلاقی مورد قبول باشد.

در نهایت، نتایج مطالعه نشان میدهد از سال 2018 به بعد، افزایش چشمگیری در انتشار مقالات دررابطهبا هوش مصنوعی و چالشهای اخلاقی وجود داشته است. این میتواند به این واقعیت مرتبط باشد که هوش مصنوعی بهطور فزایندهای در امر مراقبت استفاده میشود و توجه کمی به چالشهای اخلاقی شده است [30]. تحقیقات اخیر شواهدی ارائه میدهد که هوش مصنوعی به تیم مراقبت و درمان در فرآیند تشخیص کمک میکند، همکاری بین کارکنان مراقبتهای بهداشتی را بهبود میبخشد و به بیماران در دوره بیماری کمک میکند [12، 30] و مقرونبهصرفهتر است.

بااینحال، توسعه یک فناوری پشتیبانی معمولاً نیازمند در نظر گرفتن ملاحظات اخلاقی میباشد. سه اصل اخلاقی که تاکنون در اکثر مطالعات مورد بحث بودهاند، ضرر نرساندن، خیرخواهی و عدالت هستند. اصل ضرر نرساندن در استفاده از هوش مصنوعی به این صورت است که اگر براساس تشخیص اشتباه هوش مصنوعی کوچکترین آسیبی به مددجویان وارد شود، چگونه میتوان آن مسئله را مدیریت کرد. دررابطهبا خیرخواهی و اصل عدالت نیز این مسائل مورد انتقاد هستند [12].

هوش مصنوعی در مقایسه با سایر فناوریها، استقلال پرستاران را بیشتر تهدید میکند. درحالحاضر، هوش مصنوعی به مراقبان بهداشتی در انجام وظایف خاصی کمک میکند؛ بهعنوانمثال، سیستمها درحالحاضر قادر به جمعآوری اطلاعات سریعتر هستند، میتوانند وابستگیهای متقابل پیچیده را بهتر تفسیر کنند و مفروضاتی را بدون هیچگونه سوگیری ذهنی استخراج کنند. بهعنوانمثال، بهدلیل فشار کاری و خستگی در پرستاران، عملکرد هوش مصنوعی نتایج بهتری برای پرستاران دارد و این زنگ خطر است. بنابراین، زمانی که سیستمها مزیتهای متوالی را نسبت به انسان کسب میکنند، مطمئناً استقلال محدود میشود [13].

ازآنجاییکه از یک فناوری حمایتی به سمت تصمیمگیری مستقل میرویم، تحقیقات در زمینه خودمختاری هنوز بسیار گسترده نیست، اما در حال تبدیل شدن به یک موضوع حیاتی است. هوش مصنوعی همچنین با پردازش اطلاعات مربوط به بیماران نتایجی را بهدست میآورد، اما این نتایج ممکن است نتواند توسط انسان تفسیر گردد و مشکل باشد. بنابراین، تسلط و بینش نیروی انسانی نسبت به آن دادهها کمتر میگردد و همهچیز ماشینی میشود [14]. علاوهبراین، الگوریتمهای هوش مصنوعی با استفاده از مجموعه دادههای نمونهای که حاوی ویژگیهای خاصی است (یعنی ویژگیهای بیمار) که اگر دادهها ناقص یا نادرست باشند، خطر زیادی برای ایجاد نتایج نادرست وجود دارد که حتی ممکن است بهدلیل پیچیدگی الگوریتمهای زیربنایی دیگر قابلتشخیص نباشند. همچنین، دادههایی که برای آموزش یک الگوریتم استفاده میشوند، درحالحاضر هنوز توسط انسان طبقهبندی میشوند و ممکن است تا حدودی حاوی سوگیری ذهنی باشند [16].

خودمختاری، هدفمندی و مسئولیتپذیری در هوش مصنوعی، سیستمها یا عوامل فعلی هوش مصنوعی، مانند رباتهایی که مراقبتهای بهداشتی را انجام میدهند، ابعاد استقلال، هدفمندی و مسئولیت را در پرستاران با چالش اخلاقی مواجه میکنند. هدفمندی به توانایی یک سیستم هوش مصنوعی اشاره دارد که بهگونهای عمل کند که ازنظر اخلاقی مضر یا مفید باشد و اعمال آن عمدی و محاسبهشده باشند [17]. مطالعات نشان میدهند سیستمهای هوش مصنوعی برخی از قوانین اجتماعی را انجام میدهند و برخی مسئولیتها را بر عهده میگیرند. بااینحال، خودمختاری، هدفمندی و مسئولیتپذیری سیستمهای هوش مصنوعی چالشبرانگیز است. زمانی که یک سیستم یا عامل هوش مصنوعی در یک کار مشخص شکست میخورد و به عواقب بدی منجر میشود، چه کسی باید پاسخگو باشد [18].

در مورد عواقب نامطلوب احتمالی که توسط هوش مصنوعی ایجاد میشود، مانند اشتباه در کدهای برنامهنویسی، دادههای ورودی غلط، عملکرد نامناسب یا عوامل دیگر، چه کسی پاسخگو خواهد بود. بنابراین، پاسخگویی یک موضوع اخلاقی است که به عوامل انسانی دخیل در طراحی، پیادهسازی، استقرار و استفاده از هوش مصنوعی مربوط میشود [19].

هدف نهایی رعایت نکات اخلاقی در هوش مصنوعی این است که بتوان از اصول اخلاقی پیروی کرد و اخلاقمدارانه رفتار کرد که بسیار دشوار است. در مطالعهای پیشنهاد شده است طراحان، مهندسان نرمافزار و سایر شرکتکنندگان در طراحی و کاربرد سیستمهای هوش مصنوعی باید قوانین حقوق بشر را رعایت کنند. در صورت کوچکترین اشتباه در کاربری، ممکن است نقض حقوق بشر صورت پذیرد که این امر نیز یکی از دوراهیهای اخلاقی است [20].

تأثیر اجتماعی مسائل اخلاقی هوش مصنوعی نیز به این صورت است که جایگزینی سیستمها و رباتهای خودکار هوش مصنوعی باعث اختلال در بهکارگیری نیروهای کادر درمان، بهویژه پرستاران، میگردد. این امر بسیاری از سیاستگذاران سلامت را با ترس روبهرو کرده است. اصل عدالت و انصاف به عدم تبعیض و بیطرفی مربوط میشود [21].

نژادپرستی و تعصب جنسیتی در بسیاری از حوادث رایج است. بیشتر این موارد در زبان یا مدلهای بینایی کامپیوتری رخ میدهد. این مورد باید یک حوزه بسیار متمرکز برای متخصصان هوش مصنوعی در حین طراحی و استقرار باشد. اصل عدم سوءاستفاده نیز بر این باور است که تعهدی وجود دارد که آسیبی به دیگران وارد نشود. این اصل به نگرانیهای ایمنی، آسیب، امنیت و حفاظت مربوط میشود. این سومین موضوع رایج در دستورالعملهای اخلاقی است [22].

فناوریهای هوش مصنوعی مزایای قابلتوجهی برای پرستاری، بهویژه در تصمیمگیری و کارایی وظایف، ارائه میدهند. بااینحال، این مزایا باید در برابر نگرانیهای اخلاقی، ازجمله حفاظت از حقوق بیمار، شفافیت الگوریتمی و کاهش سوگیری، متعادل شوند. چارچوبهای نظارتی فعلی برای برآورده کردن نیازهای اخلاقی پرستاری نیاز به سازگاری دارند [27].

باتوجهبه جدول شماره 2، بررسی مطالعات نشان داد سوگیری و تبعیض بیشترین توجه را به خود اختصاص داده و در 14 مطالعه (82 درصد) گزارش شده است. پس از آن، استقلال و خودمختاری پرستار با پوشش 13 مطالعه (76 درصد) در جایگاه دوم قرار دارد. مسئولیتپذیری و پاسخگویی نیز در 12 مطالعه (71 درصد) مورد توجه قرار گرفته است.

موضوع شفافیت الگوریتمی و تفسیرپذیری در 10 مطالعه (59 درصد) بررسی شده است. دو محور امنیت، حریم خصوصی و حقوق بشر و اصل عدم آسیب و خیرخواهی هر کدام در 9 مطالعه (53 درصد) گزارش شدهاند. عدالت و انصاف با 8 مطالعه (47 درصد) و درنهایت چارچوبهای نظارتی و حقوقی با 5 مطالعه (29 درصد) کمترین فراوانی را در میان فراوانی نسبی چالش و دوراهی های اخلاقی داشتهاند.

نتیجهگیری

نتایج مطالعه حاضر نشان میدهد چالشها و دوراهیهای اخلاقی بسیاری دررابطهبا استفاده از هوش مصنوعی در پرستاری وجود دارد و در سالهای گذشته افزایش چشمگیری داشته است. ورود هوش مصنوعی به عرصه پرستاری، اگرچه نویدبخش بهبودهایی در ارائه مراقبت است، مجموعهای جدی از پرسشها و تردیدهای اخلاقی را پیش روی پرستاران و نظام سلامت قرار میدهد که نمیتوان آنها را نادیده گرفت. یافتههای ما بهوضوح نشان میدهد این فناوری، صرفاً یک ابزار کمکی نیست، بلکه عاملی است که میتواند نحوه تصمیمگیری، تعامل و درنهایت کیفیت مراقبت ارائهشده توسط پرستاران را بهطور بنیادین تحت تأثیر قرار دهد.

بهکارگیری هوش مصنوعی در پرستاری، با وجود مزایایی مانند کمک به تشخیص، بهبود همکاری و مقرونبهصرفهتر بودن، چالشها و دوراهیهای اخلاقی متعددی را برای پرستاران ایجاد میکند. این چالشها شامل مسائلی نظیر سوگیری و تبعیض در الگوریتمها، عدم شفافیت در عملکرد آنها، تهدید استقلال پرستاران، ابهامات در مورد مسئولیتپذیری در صورت بروز خطا، و نگرانیهای مربوط به اصول اخلاقی سنتی مانند ضرر نرساندن، خیرخواهی و عدالت است.

چالشهای اخلاقی در استفاده از هوش مصنوعی در مراقبتهای پرستاری، بهویژه درمورد عدالت، استقلال، عدم ضرررسانی، سودرسانی و مسئولیتپذیری رایج هستند. مطالعاتی که استفاده از هوش مصنوعی را نیازمند حل کردن دوراهیها و چالشهای اخلاقی میدانند نیز بسیار است. پیشنهاد میشود در مطالعات آتی به بررسی دقیق و یافتن راهحلهایی برای اطمینان از اجرای اخلاقی و مسئولانه استفاده از هوش مصنوعی در مراقبتهای بهداشتی پرداخته شود.

ملاحظات اخلاقی

پیروی از اصول اخلاق پژوهش

در تدوین این مقاله مروری، کلیه اصول اخلاق پژوهش رعایت شده است. تمامی یافتهها و متون از مقالات دیگر، با استناد به منبع اصلی و مطابق با قواعد سرقت ادبی، بهطور مناسب ذکر شدهاند. از آنجاییکه این مطالعه مبتنی بر دادههای منتشرشده قبلی است، با کسب مجوز از کمیته اخلاق دانشگاه علوم پزشکی اردبیل با شناسه اخلاق (IR.ARUMS.REC.1404.114.) انجام شد.

حامی مالی

این پژوهش هیچگونه کمک مالی از سازمانیهای دولتی، خصوصی و غیرانتفاعی دریافت نکرده است.

مشارکت نویسندگان

مفهومسازی: مژده طاهری افشار؛ روششناسی: مژده طاهری افشار و مصطفی رجبزاده؛ اعتبارسنجی و نظارت: محسن پورصادقی؛ تحلیل و منابع: امیرحسین نادی؛ تحقیق و بررسی: ملیحه اسحاقزاده؛ نگارش پیشنویس و بصریسازی: مصطفی رجبزاده؛ ویراستاری و نهاییسازی نوشته: مصطفی رجبزاده و محسن پورصادقی؛ مدیریت پروژه: محسن پورصادقی و ملیحه اسحاقزاده.

تعارض منافع

بنابر اظهار نویسندگان، این مقاله تعارض منافع ندارد.

متن کامل: (74 مشاهده)

مقدمه

با پیشرفت فناوری هوش مصنوعی، میتوان از آن در حوزه پرستاری و مامایی بهمنظور بهبود تصمیمگیری، ارائه مراقبت بهتر به بیماران و بهبود عملکرد سیستم بهداشتی استفاده کرد [1]. ازاینرو، کاربرد هوش مصنوعی در این حوزهها بهعنوان یک رویکرد مؤثر و نوین در ارائه خدمات مراقبتی مورد توجه قرار گرفته است [2]. همچنین، هوش مصنوعی میتواند برای پشتیبانی از تصمیمگیری بالینی پرستاران در موقعیتهای پیچیده مراقبتی یا انجام وظایفی همانند فرآیند مستندسازی مورد استفاده قرار گیرد [3]. دیجیتالی شدن و توسعه فناوری، هوش مصنوعی را قادر ساخته است تا از ارائه مراقبتهای بهداشتی و پرستاری بهتر پشتیبانی کند. فناوریهای هوش مصنوعی، سیستمهایی هستند که رفتار هوشمندانهای از خود نشان میدهند و با تجزیهوتحلیل محیط خود میتوانند وظایف مختلفی را با درجاتی از خودمختاری برای دستیابی به اهداف خاص انجام دهند [4].

فناوریهای هوش مصنوعی برای مدتزمان طولانی در پرستاری مورد استفاده قرار گرفتهاند، اگرچه بهعنوان هوش مصنوعی شناخته نمیشدهاند. باوجوداین موضوع، کاربرد هوش مصنوعی در مراقبتهای بهداشتی باتوجهبه تحقیقات و مباحث جدید میتواند بیش از پیش مورد توجه قرار گیرد [5]. علیرغم افزایش تحقیقات در کاربرد فناوریهای دیجیتال درجهت افزایش کیفیت مراقبتهای پرستاری، از هوش مصنوعی در مراقبتهای پرستاری کمتر استفاده میشود. در سالهای اخیر، شاهد افزایش تحقیقاتی بودهایم که بر احتمال توسعه هوش مصنوعی در مراقبتهای پرستاری تأکید کرده است [6]. از هوش مصنوعی میتوان برای برنامهریزی و زمانبندی بهتر و خودکار و همچنین برای بهبود کارایی روشهای انسانی مانند ایجاد فهرست کارکنان پرستاری یا تصمیمهای زمانبندی مربوط به مراقبت و برای حمایت از پرستاران در وظایفی که از راه دور در تعامل مستقیم با بیمار وظایف خود را انجام میدهند، استفاده کرد [7].

علاوهبراین، هوش مصنوعی بهعنوان ابزاری معرفی شده است که میتواند ارائه مراقبتهای بهداشتی را تغییر دهد و باعث ارتقای سلامتی در بیماران گردد؛ درنتیجه، با رشد هوش مصنوعی، این ابزار وارد سیستم مراقبت بهداشت شده و پرستاران نیز باید متناسب با این رشد بهروز شوند [8]. تاکنون، مطالعات اندکی در مورد ارتباط عملی و کاربرد سیستمهای هوش مصنوعی با الزامات خاص در مراقبتهای پرستاری انجام شده است. هوش مصنوعی میتواند به ارائه کیفیت بالا، مراقبت کارآمدتر و عادلانهتر کمک کند؛ همچنین متخصصانی که تجربه کمتری دارند را مورد حمایت قرار دهد، مانند کمک برای شناسایی نشانههای بیماریهای نادر از طریق جستوجوی گسترده در پایگاه دادهها.

از دیگر کاربردهای هوش مصنوعی در پرستاری میتوان به فناوریهای تشخیص گفتار پرستار اشاره کرد که در آن اسناد مربوط به بیمار با کمک اصطلاحات و کلیدواژههایی که در اختیار هوش مصنوعی قرار داده میشود بهسرعت در دسترس پرستار قرار میگیرد [9، 10]. استخراج میلیونها یادداشت پرستاری برای شناسایی بیماران مبتلا به سابقه سقوط یا اختلالات مصرف مواد مخدر، الکل، حمایت از برنامهریزی برای مراقبت و تشخیص خطر بیمار، از کاربردهای هوش مصنوعی در پرستاری است. پرستاران باید اطمینان حاصل کنند که یکپارچهسازی هوش مصنوعی در سیستم بهداشت بهگونهای صورت میگیرد که عاری از چالش اخلاقی باشد و با ارزشهای پرستاری اصلی مانند مراقبت مهربانانه و مراقبت کلنگر هماهنگ باشد [11].

یکی از مهمترین چالشهای اخلاقی در حوزه استفاده از هوش مصنوعی، دوراهی اخلاقی است. دوراهی اخلاقی یکی از انواع تعارضات اخلاقی است و درواقع هرگونه ناسازگاری بین انگیزه و تمایلات، روشهای تربیتی، ارزشها و عمل به تکلیف و مسئولیت اخلاقی میباشد [1]. تعارض اخلاقی، تداخل ارزشهای اخلاقی در موقعیت عمل اخلاقی و تعارض بین انگیزههای درونی و اخلاقی فرد است [12].

چالشهای اخلاقی که در استفاده از هوش مصنوعی در مراقبت پرستاری وجود دارد و باید در نظر گرفته شود شامل کمبود تماس و تعامل انسانی، محدودیت در تفسیر نیازهای بیمار، توانایی محدود هوش مصنوعی در ارائه مراقبتهای فیزیکی و جسمانی، توانایی محدود در مواجهه با شرایط پیچیده مانند تفکر انتقادی و مهارتهای تصمیمگیری، وابستگی به کیفیت دادهها، مشکلات اخلاقی مربوط به حریم خصوصی بیمار و امنیت دادهها، تأثیر بر استقلال بیمار، رضایت آگاهانه، ایمنی و شفافیت در دستورالعملها، حریم خصوصی، پاسخگویی و شفافیت [13، 14].

همچنین، هوش مصنوعی میتواند اثرات ناخواستهای در ارائه مراقبتهای بهداشتی داشته باشد. علیرغم اینکه پتانسیل توسعه عملکرد پرستاران را دارد، اما ازنظر اصول اخلاقی، نقش پرستار در استفاده از هوش مصنوعی سنگینتر خواهد شد. پرستار برای تشخیص و تفکیک دوراهیهای اخلاقی نیازمند درک دقیق از چالشهای اخلاقی میباشد تا وضعیت چالشبرانگیز موجود را مدیریت نماید. بااینحال، اگرچه ما چهار مفهوم اخلاقی مهم در پرستاری-حمایت، پاسخگویی، همکاری و مراقبت- را بررسی خواهیم کرد، اما اینها پایان فهرست مفاهیم اخلاقی مرتبط در پرستاری نیستند [15].

همچنین در پرستاران بین کیفیت زندگی کاری، اخلاقی و سابقه کاری ارتباطی وجود ندارد. بااینحال تعداد بیشتری از افرادی که سابقه کاری بیشتری داشتند کیفیت زندگی کاری، اخلاقی خود را خوب ارزیابی کردهاند [16].

درواقع با حفظ ارزشهای اخلاقی پرستاری اصلی مانند مراقبتهای پرستاری دقیق و عاری از تردید اخلاقی، از این فناوری بهدرستی استفاده نماید. برایناساس، مطالعه مروری حاضر با هدف بررسی دوراهی اخلاقی هوش مصنوعی در پرستاری انجام شد.

مواد و روشها

این مطالعه از نوع مروری نظاممند است. مراحل انجامشده عبارتاند از:

روش جستوجو

جستوجو و استخراج مطالعات وابسته به تحقیق

این مطالعه بهطور مستقل توسط دو محقق براساس اهداف تحقیق و چکلیست پریزما انجام شد. جستوجوی جامع مقالات از ابتدای ژانویه سال 2018 تا پایان آوریل سال 2025 در پایگاههای اطلاعاتی پابمد، اسکپوس، کتابخانه دیجیتال ایسیام، مدلاین، وبآوساینس و همچنین موتورهای جستوجوی پایگاه مرکز اطلاعات علمی جهاد دانشگاهی و مگیران و با استفاده از استراتژی «مش» و کلیدواژههای «اخلاق»، «هوش مصنوعی» و «پرستاری» و کلیدواژههای انگلیسی Nursing »، Artificial Intelligence،« Ethics و با استفاده از عملگرهای بولین انجام گردید. جهت افزایش روایی یافتههای مطالعه و کنترل سوگیری در ورود دادهها، فرآیند جستوجو و ارزیابی مقالات بهدقت انجام شد. مقالاتی که برای ارزیابی نهایی انتخاب شدند، پس از دسترسی به متن کامل، توسط دو نویسنده بهطور مستقل برای بررسی معیارهای ورود و خروج مورد ارزیابی قرار گرفتند. مقالاتی که دارای معیارهای ورود بودند، برای ورود به مطالعه انتخاب شدند. این فرآیند توسط فرد سومی نظارت شد.

شرایط ورود و خروج به مطالعه

معیارهای ورود شامل تمامی مقالاتی است که به بررسی هوش مصنوعی، دوراهی اخلاقی و پرستاری پرداخته و متن کامل آنها در دسترس و به زبان فارسی یا انگلیسی نگارش شده باشد. این معیارها عبارتاند از:

معیارهای ورود

مطالعات مرتبط با هوش مصنوعی و کاربرد آن در حوزه پرستاری-بهویژه در زمینه دوراهیهای اخلاقی- مطالعات پژوهشی، مرور نظاممند، مقالات تحلیلی، و گزارشهای موردی که به مسائل اخلاقی در پرستاری و فناوریهای هوش مصنوعی پرداختهاند؛

مقالات به زبان فارسی یا انگلیسی، متن کامل مقاله در دسترس باشد؛ مطالعات منتشرشده از سال 2018 تا 2025 تا بهروز بودن اطلاعات و نتایج را تضمین کند؛ مقالاتی که دادهها و شواهد تجربی را در زمینه دوراهیهای اخلاقی در استفاده از هوش مصنوعی در پرستاری ارائه میدهند.

معیارهای خروج

مقالاتی که به طور مستقیم به دوراهیهای اخلاقی در پرستاری و هوش مصنوعی نمیپردازند ؛مطالعاتی که از لحاظ روششناسی یا اعتبار ضعیف هستند یا نتایج غیرقابلاستناد دارند؛ مقالاتی که بیشتر به جنبههای فنی هوش مصنوعی یا کاربرد آن در پرستاری بدون تحلیل اخلاقی میپردازند؛ مقالاتی که بیشتر به جنبههای فنی هوش مصنوعی یا کاربرد آن در پرستاری بدون تحلیل اخلاقی میپرداختند و مقالاتی که به زبانهایی غیر از فارسی یا انگلیسی نوشته شدهاند.

ارزیابی کیفیت مقالات

ابتدا اعتبار مقالات با استفاده از چکلیست پذیزما مورد ارزیابی قرار گرفت. ارزیابی مقالات بصورت جداگانه توسط دو محقق انجام شد. در صورت بروز اختلاف نظر دو نفر محقق ، ناظر مقاله ها را بررسی کرد و نظرات ایشان بعنوان تصمیم نهایی اعمال شد. برای جمع آوری داده های مقالات منتخب نهایی فرم استخراج و طبقه بندی داده ها که شامل نام نویسنده، عنوان، کشور، سال و نتایج بود استفاده شد. کاهش، نمایش، مقایسه و جمع بندی داده ها انجام شد. دراین مطالعه بر نتایج مقالات تفسیر صورت گرفت و تا حد امکان نیز از اصل مقالات که توسط نویسنده به کار رفته بود، استفاده گردید.

استخراج مقالات مطابق با معیارهای ورود

با بهرهگیری از کلیدواژهها در انتهای جستوجو، 20 مقاله از پایگاههای فارسی و 42 مقاله از پایگاههای بینالمللی و در مجموع 62 مطالعه جمعآوری شد. مطالعات براساس معیارهای ورود مورد بررسی قرار گرفتند. انتخاب مطالعات مرتبط بهگونهای صورت گرفت که ابتدا لیستی از عناوین و چکیده تمام مقالات موجود در پایگاههای اطلاعاتی توسط پژوهشگران تهیه شد. در ادامه با مرور دقیق بر عنوان و چکیده مقالات، تعداد زیادی از آنها بهعلت غیرمرتبط بودن با هدف مطالعه کنار گذاشته شد و در صورتی که پس از مطالعه عنوان و چکیده، امکان تصمیمگیری در مورد مطالعه وجود نداشت، متن کامل آن مورد مطالعه قرار گرفت. سپس مقالات مرتبط بهطور مستقل وارد فرآیند پژوهش شدند و در نهایت17 مقاله وارد مطالعه شد (تصویر شماره 1).

با پیشرفت فناوری هوش مصنوعی، میتوان از آن در حوزه پرستاری و مامایی بهمنظور بهبود تصمیمگیری، ارائه مراقبت بهتر به بیماران و بهبود عملکرد سیستم بهداشتی استفاده کرد [1]. ازاینرو، کاربرد هوش مصنوعی در این حوزهها بهعنوان یک رویکرد مؤثر و نوین در ارائه خدمات مراقبتی مورد توجه قرار گرفته است [2]. همچنین، هوش مصنوعی میتواند برای پشتیبانی از تصمیمگیری بالینی پرستاران در موقعیتهای پیچیده مراقبتی یا انجام وظایفی همانند فرآیند مستندسازی مورد استفاده قرار گیرد [3]. دیجیتالی شدن و توسعه فناوری، هوش مصنوعی را قادر ساخته است تا از ارائه مراقبتهای بهداشتی و پرستاری بهتر پشتیبانی کند. فناوریهای هوش مصنوعی، سیستمهایی هستند که رفتار هوشمندانهای از خود نشان میدهند و با تجزیهوتحلیل محیط خود میتوانند وظایف مختلفی را با درجاتی از خودمختاری برای دستیابی به اهداف خاص انجام دهند [4].

فناوریهای هوش مصنوعی برای مدتزمان طولانی در پرستاری مورد استفاده قرار گرفتهاند، اگرچه بهعنوان هوش مصنوعی شناخته نمیشدهاند. باوجوداین موضوع، کاربرد هوش مصنوعی در مراقبتهای بهداشتی باتوجهبه تحقیقات و مباحث جدید میتواند بیش از پیش مورد توجه قرار گیرد [5]. علیرغم افزایش تحقیقات در کاربرد فناوریهای دیجیتال درجهت افزایش کیفیت مراقبتهای پرستاری، از هوش مصنوعی در مراقبتهای پرستاری کمتر استفاده میشود. در سالهای اخیر، شاهد افزایش تحقیقاتی بودهایم که بر احتمال توسعه هوش مصنوعی در مراقبتهای پرستاری تأکید کرده است [6]. از هوش مصنوعی میتوان برای برنامهریزی و زمانبندی بهتر و خودکار و همچنین برای بهبود کارایی روشهای انسانی مانند ایجاد فهرست کارکنان پرستاری یا تصمیمهای زمانبندی مربوط به مراقبت و برای حمایت از پرستاران در وظایفی که از راه دور در تعامل مستقیم با بیمار وظایف خود را انجام میدهند، استفاده کرد [7].

علاوهبراین، هوش مصنوعی بهعنوان ابزاری معرفی شده است که میتواند ارائه مراقبتهای بهداشتی را تغییر دهد و باعث ارتقای سلامتی در بیماران گردد؛ درنتیجه، با رشد هوش مصنوعی، این ابزار وارد سیستم مراقبت بهداشت شده و پرستاران نیز باید متناسب با این رشد بهروز شوند [8]. تاکنون، مطالعات اندکی در مورد ارتباط عملی و کاربرد سیستمهای هوش مصنوعی با الزامات خاص در مراقبتهای پرستاری انجام شده است. هوش مصنوعی میتواند به ارائه کیفیت بالا، مراقبت کارآمدتر و عادلانهتر کمک کند؛ همچنین متخصصانی که تجربه کمتری دارند را مورد حمایت قرار دهد، مانند کمک برای شناسایی نشانههای بیماریهای نادر از طریق جستوجوی گسترده در پایگاه دادهها.

از دیگر کاربردهای هوش مصنوعی در پرستاری میتوان به فناوریهای تشخیص گفتار پرستار اشاره کرد که در آن اسناد مربوط به بیمار با کمک اصطلاحات و کلیدواژههایی که در اختیار هوش مصنوعی قرار داده میشود بهسرعت در دسترس پرستار قرار میگیرد [9، 10]. استخراج میلیونها یادداشت پرستاری برای شناسایی بیماران مبتلا به سابقه سقوط یا اختلالات مصرف مواد مخدر، الکل، حمایت از برنامهریزی برای مراقبت و تشخیص خطر بیمار، از کاربردهای هوش مصنوعی در پرستاری است. پرستاران باید اطمینان حاصل کنند که یکپارچهسازی هوش مصنوعی در سیستم بهداشت بهگونهای صورت میگیرد که عاری از چالش اخلاقی باشد و با ارزشهای پرستاری اصلی مانند مراقبت مهربانانه و مراقبت کلنگر هماهنگ باشد [11].

یکی از مهمترین چالشهای اخلاقی در حوزه استفاده از هوش مصنوعی، دوراهی اخلاقی است. دوراهی اخلاقی یکی از انواع تعارضات اخلاقی است و درواقع هرگونه ناسازگاری بین انگیزه و تمایلات، روشهای تربیتی، ارزشها و عمل به تکلیف و مسئولیت اخلاقی میباشد [1]. تعارض اخلاقی، تداخل ارزشهای اخلاقی در موقعیت عمل اخلاقی و تعارض بین انگیزههای درونی و اخلاقی فرد است [12].

چالشهای اخلاقی که در استفاده از هوش مصنوعی در مراقبت پرستاری وجود دارد و باید در نظر گرفته شود شامل کمبود تماس و تعامل انسانی، محدودیت در تفسیر نیازهای بیمار، توانایی محدود هوش مصنوعی در ارائه مراقبتهای فیزیکی و جسمانی، توانایی محدود در مواجهه با شرایط پیچیده مانند تفکر انتقادی و مهارتهای تصمیمگیری، وابستگی به کیفیت دادهها، مشکلات اخلاقی مربوط به حریم خصوصی بیمار و امنیت دادهها، تأثیر بر استقلال بیمار، رضایت آگاهانه، ایمنی و شفافیت در دستورالعملها، حریم خصوصی، پاسخگویی و شفافیت [13، 14].

همچنین، هوش مصنوعی میتواند اثرات ناخواستهای در ارائه مراقبتهای بهداشتی داشته باشد. علیرغم اینکه پتانسیل توسعه عملکرد پرستاران را دارد، اما ازنظر اصول اخلاقی، نقش پرستار در استفاده از هوش مصنوعی سنگینتر خواهد شد. پرستار برای تشخیص و تفکیک دوراهیهای اخلاقی نیازمند درک دقیق از چالشهای اخلاقی میباشد تا وضعیت چالشبرانگیز موجود را مدیریت نماید. بااینحال، اگرچه ما چهار مفهوم اخلاقی مهم در پرستاری-حمایت، پاسخگویی، همکاری و مراقبت- را بررسی خواهیم کرد، اما اینها پایان فهرست مفاهیم اخلاقی مرتبط در پرستاری نیستند [15].

همچنین در پرستاران بین کیفیت زندگی کاری، اخلاقی و سابقه کاری ارتباطی وجود ندارد. بااینحال تعداد بیشتری از افرادی که سابقه کاری بیشتری داشتند کیفیت زندگی کاری، اخلاقی خود را خوب ارزیابی کردهاند [16].

درواقع با حفظ ارزشهای اخلاقی پرستاری اصلی مانند مراقبتهای پرستاری دقیق و عاری از تردید اخلاقی، از این فناوری بهدرستی استفاده نماید. برایناساس، مطالعه مروری حاضر با هدف بررسی دوراهی اخلاقی هوش مصنوعی در پرستاری انجام شد.

مواد و روشها

این مطالعه از نوع مروری نظاممند است. مراحل انجامشده عبارتاند از:

روش جستوجو

جستوجو و استخراج مطالعات وابسته به تحقیق

این مطالعه بهطور مستقل توسط دو محقق براساس اهداف تحقیق و چکلیست پریزما انجام شد. جستوجوی جامع مقالات از ابتدای ژانویه سال 2018 تا پایان آوریل سال 2025 در پایگاههای اطلاعاتی پابمد، اسکپوس، کتابخانه دیجیتال ایسیام، مدلاین، وبآوساینس و همچنین موتورهای جستوجوی پایگاه مرکز اطلاعات علمی جهاد دانشگاهی و مگیران و با استفاده از استراتژی «مش» و کلیدواژههای «اخلاق»، «هوش مصنوعی» و «پرستاری» و کلیدواژههای انگلیسی Nursing »، Artificial Intelligence،« Ethics و با استفاده از عملگرهای بولین انجام گردید. جهت افزایش روایی یافتههای مطالعه و کنترل سوگیری در ورود دادهها، فرآیند جستوجو و ارزیابی مقالات بهدقت انجام شد. مقالاتی که برای ارزیابی نهایی انتخاب شدند، پس از دسترسی به متن کامل، توسط دو نویسنده بهطور مستقل برای بررسی معیارهای ورود و خروج مورد ارزیابی قرار گرفتند. مقالاتی که دارای معیارهای ورود بودند، برای ورود به مطالعه انتخاب شدند. این فرآیند توسط فرد سومی نظارت شد.

شرایط ورود و خروج به مطالعه

معیارهای ورود شامل تمامی مقالاتی است که به بررسی هوش مصنوعی، دوراهی اخلاقی و پرستاری پرداخته و متن کامل آنها در دسترس و به زبان فارسی یا انگلیسی نگارش شده باشد. این معیارها عبارتاند از:

معیارهای ورود

مطالعات مرتبط با هوش مصنوعی و کاربرد آن در حوزه پرستاری-بهویژه در زمینه دوراهیهای اخلاقی- مطالعات پژوهشی، مرور نظاممند، مقالات تحلیلی، و گزارشهای موردی که به مسائل اخلاقی در پرستاری و فناوریهای هوش مصنوعی پرداختهاند؛

مقالات به زبان فارسی یا انگلیسی، متن کامل مقاله در دسترس باشد؛ مطالعات منتشرشده از سال 2018 تا 2025 تا بهروز بودن اطلاعات و نتایج را تضمین کند؛ مقالاتی که دادهها و شواهد تجربی را در زمینه دوراهیهای اخلاقی در استفاده از هوش مصنوعی در پرستاری ارائه میدهند.

معیارهای خروج

مقالاتی که به طور مستقیم به دوراهیهای اخلاقی در پرستاری و هوش مصنوعی نمیپردازند ؛مطالعاتی که از لحاظ روششناسی یا اعتبار ضعیف هستند یا نتایج غیرقابلاستناد دارند؛ مقالاتی که بیشتر به جنبههای فنی هوش مصنوعی یا کاربرد آن در پرستاری بدون تحلیل اخلاقی میپردازند؛ مقالاتی که بیشتر به جنبههای فنی هوش مصنوعی یا کاربرد آن در پرستاری بدون تحلیل اخلاقی میپرداختند و مقالاتی که به زبانهایی غیر از فارسی یا انگلیسی نوشته شدهاند.

ارزیابی کیفیت مقالات

ابتدا اعتبار مقالات با استفاده از چکلیست پذیزما مورد ارزیابی قرار گرفت. ارزیابی مقالات بصورت جداگانه توسط دو محقق انجام شد. در صورت بروز اختلاف نظر دو نفر محقق ، ناظر مقاله ها را بررسی کرد و نظرات ایشان بعنوان تصمیم نهایی اعمال شد. برای جمع آوری داده های مقالات منتخب نهایی فرم استخراج و طبقه بندی داده ها که شامل نام نویسنده، عنوان، کشور، سال و نتایج بود استفاده شد. کاهش، نمایش، مقایسه و جمع بندی داده ها انجام شد. دراین مطالعه بر نتایج مقالات تفسیر صورت گرفت و تا حد امکان نیز از اصل مقالات که توسط نویسنده به کار رفته بود، استفاده گردید.

استخراج مقالات مطابق با معیارهای ورود

با بهرهگیری از کلیدواژهها در انتهای جستوجو، 20 مقاله از پایگاههای فارسی و 42 مقاله از پایگاههای بینالمللی و در مجموع 62 مطالعه جمعآوری شد. مطالعات براساس معیارهای ورود مورد بررسی قرار گرفتند. انتخاب مطالعات مرتبط بهگونهای صورت گرفت که ابتدا لیستی از عناوین و چکیده تمام مقالات موجود در پایگاههای اطلاعاتی توسط پژوهشگران تهیه شد. در ادامه با مرور دقیق بر عنوان و چکیده مقالات، تعداد زیادی از آنها بهعلت غیرمرتبط بودن با هدف مطالعه کنار گذاشته شد و در صورتی که پس از مطالعه عنوان و چکیده، امکان تصمیمگیری در مورد مطالعه وجود نداشت، متن کامل آن مورد مطالعه قرار گرفت. سپس مقالات مرتبط بهطور مستقل وارد فرآیند پژوهش شدند و در نهایت17 مقاله وارد مطالعه شد (تصویر شماره 1).

جدولبندی و خلاصه کردن اطلاعات و دادهها

در این مرحله پس از اینکه دادهها استخراج گردید، کلیه دادههای مطالعات براساس نام نویسنده اول، سال، مکان، عنوان و یافتههای پژوهش در جدول شماره 1 خلاصه شد.

همچنین در جدول شماره 2 فراوانی نسبی چالش و دوراهیهای اخلاقی در مطالعات مرورشده و جدول شماره 3 تحلیل همبستگی چالشهای اخلاقی (بر مبنای هموقوعی) آورده شده است.

گزارش نتایج

پس از مطالعه خلاصه و متن کامل مقالات مرتبط با موضوع تحقیق اطلاعات موردنظر برای انجام نگارش استخراج شد. اطلاعات لازم برای هر مطالعه شامل نام نویسنده، سال، مکان، نوع مطالعه، روش نمونهگیری، ابزار گردآوری اطلاعات و نتایج بود. در انتها، اطلاعات حاصل از مقالات طبقهبندی شد و در نهایت بهصورت متن کامل یک مقاله مروری گزارش شد.

یافتهها

در مجموع، 62 مطالعه از پایگاهها بازیابی شدند. پس از بررسی مقالات براساس عنوان و چکیده، 10 مقاله غیرمرتبط حذف شدند. از 52 مقاله باقیمانده، پس از بررسی متن کامل آنها، در نهایت 17 مطالعه واجد شرایط ورود به مرور بودند (تصویر شماره 1) . فرآیند انتخاب مطالعات براساس پروتکل پریزما انجام شد و مشخصات مطالعات واردشده به مرور در جدول شماره 1 نشان داده شده است. استفاده از هوش مصنوعی در مراقبتهای سلامت، چالشهای اخلاقی متعددی را به همراه دارد که باید مدنظر قرار گیرند.

استفاده از هوش مصنوعی در مراقبتهای سلامت ممکن است بر استقلال بیمار تأثیر بگذارد و نیاز به اطمینان از مشارکت بیمار در فرآیند تصمیمگیریهای مراقبتی وجود دارد. هوش مصنوعی در عمل با چالشهای فوری در یکپارچهسازی با مسائل بالینی مواجه است، ازجمله اینکه چگونه با اخذ رضایت آگاهانه هماهنگ شود. در استفاده از هوش مصنوعی در مراقبتهای سلامت، نیاز به ایمنی، شفافیت و وضوح در دستورالعملها و مقررات وجود دارد. استفاده از هوش مصنوعی در مراقبتهای سلامت شامل جمعآوری دادههای شخصی و حساس است که باید از حملات سایبری محافظت شود و حریم خصوصی اطلاعات بیماران حفظ گردد. توسعه و استفاده از هوش مصنوعی در مراقبتهای سلامت نیازمند پاسخگویی بهموقع و شفافیت است.

استفاده از هوش مصنوعی در مراقبتهای سلامت، علیرغم مزایای متعدد، محدودیتها و چالشهای اخلاقی متعددی را به همراه دارد که باید به آنها پرداخته شود، ازجمله رضایت آگاهانه، ایمنی و وضوح دستورالعملها، حریم خصوصی دادههای مرتبط با بیمار، پاسخگویی و تأثیر بر استقلال بیمار. ایجاد دستورالعملها و مقررات واضح برای تضمین توسعه و پیادهسازی هوش مصنوعی به روشی اخلاقی و پاسخگو دارای اهمیت است. در جدول شماره 1، این موضوع بهصورت دقیق بررسی شده است.

بحث

این مطالعه با بررسی دقیق 17 مقاله مرتبط، به واکاوی چالشهای اخلاقی ناشی از بهکارگیری هوش مصنوعی (AI) در حوزه پرستاری پرداخته است. یافتههای ما بهوضوح نشان میدهند که ورود هوش مصنوعی به عرصه مراقبتهای پرستاری، مجموعهای از دوراهیهای اخلاقی را برای پرستاران ایجاد میکند که میتواند بر روند تصمیمگیری و عملکرد آنها در موقعیتهای حساس بالینی تأثیرگذار باشد. این تردیدها و چالشها صرفاً جنبه نظری ندارند، بلکه ریشه در ماهیت تکنولوژیهای هوش مصنوعی و کاربرد آنها در محیطهای پیچیده مراقبت سلامت دارند.

یافتههای این مطالعه نشان داد استفاده از هوش مصنوعی میتواند چالشهای اخلاقی متعددی ایجاد کند و پرستاران را در مسیر دوراهی و تردید در انتخاب و عملکرد دررابطهبا مسائل اخلاقی جهت انجام امور مراقبتی قرار دهد. تاآنجاکه مطالعات مختلفی در این زمینه انجام شده و مسائل اخلاقی را تجزیهوتحلیل کردهاند، پیشرفتهای اخیر در زمینه هوش مصنوعی در سلامت و مراقبت، با برخی مسائل اخلاقی همراه است. چالشهایی دررابطهبا سوگیری، تبعیض، عدم شفافیت، نگرانیهای منطقی یا ناهنجاریها وجود دارد.

یکی از مهمترین چالشها، مسئله سوگیری (Bias) در الگوریتمهای هوش مصنوعی است. الگوریتمها براساس دادههایی آموزش میبینند که ممکن است خود شامل سوگیریهای تاریخی، فرهنگی یا اجتماعی باشند. این سوگیریها میتوانند منجر به تبعیض در ارائه مراقبتها شوند؛ برایمثال، توصیههای هوش مصنوعی ممکن است برای گروههای خاصی از بیماران (مانند اقلیتهای قومی یا بیماران با وضعیت اقتصادی-اجتماعی پایین) کمتر دقیق یا حتی مضر باشند. علاوهبراین، سؤالهای مختلفی وجود دارد که سعی میکنند به مسائلی نظیر اجازه تعامل یا مداخله هوش مصنوعی و اینکه آیا سیستمها باید حمایتکننده یا تصمیمگیر باشند، پاسخ دهند. اگرچه هوش مصنوعی بهطور مکرر در مراقبتهای پرستاری میتواند مورد استفاده قرار گیرد، باید از منظر اخلاقی مورد قبول باشد.

در نهایت، نتایج مطالعه نشان میدهد از سال 2018 به بعد، افزایش چشمگیری در انتشار مقالات دررابطهبا هوش مصنوعی و چالشهای اخلاقی وجود داشته است. این میتواند به این واقعیت مرتبط باشد که هوش مصنوعی بهطور فزایندهای در امر مراقبت استفاده میشود و توجه کمی به چالشهای اخلاقی شده است [30]. تحقیقات اخیر شواهدی ارائه میدهد که هوش مصنوعی به تیم مراقبت و درمان در فرآیند تشخیص کمک میکند، همکاری بین کارکنان مراقبتهای بهداشتی را بهبود میبخشد و به بیماران در دوره بیماری کمک میکند [12، 30] و مقرونبهصرفهتر است.

بااینحال، توسعه یک فناوری پشتیبانی معمولاً نیازمند در نظر گرفتن ملاحظات اخلاقی میباشد. سه اصل اخلاقی که تاکنون در اکثر مطالعات مورد بحث بودهاند، ضرر نرساندن، خیرخواهی و عدالت هستند. اصل ضرر نرساندن در استفاده از هوش مصنوعی به این صورت است که اگر براساس تشخیص اشتباه هوش مصنوعی کوچکترین آسیبی به مددجویان وارد شود، چگونه میتوان آن مسئله را مدیریت کرد. دررابطهبا خیرخواهی و اصل عدالت نیز این مسائل مورد انتقاد هستند [12].

هوش مصنوعی در مقایسه با سایر فناوریها، استقلال پرستاران را بیشتر تهدید میکند. درحالحاضر، هوش مصنوعی به مراقبان بهداشتی در انجام وظایف خاصی کمک میکند؛ بهعنوانمثال، سیستمها درحالحاضر قادر به جمعآوری اطلاعات سریعتر هستند، میتوانند وابستگیهای متقابل پیچیده را بهتر تفسیر کنند و مفروضاتی را بدون هیچگونه سوگیری ذهنی استخراج کنند. بهعنوانمثال، بهدلیل فشار کاری و خستگی در پرستاران، عملکرد هوش مصنوعی نتایج بهتری برای پرستاران دارد و این زنگ خطر است. بنابراین، زمانی که سیستمها مزیتهای متوالی را نسبت به انسان کسب میکنند، مطمئناً استقلال محدود میشود [13].

ازآنجاییکه از یک فناوری حمایتی به سمت تصمیمگیری مستقل میرویم، تحقیقات در زمینه خودمختاری هنوز بسیار گسترده نیست، اما در حال تبدیل شدن به یک موضوع حیاتی است. هوش مصنوعی همچنین با پردازش اطلاعات مربوط به بیماران نتایجی را بهدست میآورد، اما این نتایج ممکن است نتواند توسط انسان تفسیر گردد و مشکل باشد. بنابراین، تسلط و بینش نیروی انسانی نسبت به آن دادهها کمتر میگردد و همهچیز ماشینی میشود [14]. علاوهبراین، الگوریتمهای هوش مصنوعی با استفاده از مجموعه دادههای نمونهای که حاوی ویژگیهای خاصی است (یعنی ویژگیهای بیمار) که اگر دادهها ناقص یا نادرست باشند، خطر زیادی برای ایجاد نتایج نادرست وجود دارد که حتی ممکن است بهدلیل پیچیدگی الگوریتمهای زیربنایی دیگر قابلتشخیص نباشند. همچنین، دادههایی که برای آموزش یک الگوریتم استفاده میشوند، درحالحاضر هنوز توسط انسان طبقهبندی میشوند و ممکن است تا حدودی حاوی سوگیری ذهنی باشند [16].

خودمختاری، هدفمندی و مسئولیتپذیری در هوش مصنوعی، سیستمها یا عوامل فعلی هوش مصنوعی، مانند رباتهایی که مراقبتهای بهداشتی را انجام میدهند، ابعاد استقلال، هدفمندی و مسئولیت را در پرستاران با چالش اخلاقی مواجه میکنند. هدفمندی به توانایی یک سیستم هوش مصنوعی اشاره دارد که بهگونهای عمل کند که ازنظر اخلاقی مضر یا مفید باشد و اعمال آن عمدی و محاسبهشده باشند [17]. مطالعات نشان میدهند سیستمهای هوش مصنوعی برخی از قوانین اجتماعی را انجام میدهند و برخی مسئولیتها را بر عهده میگیرند. بااینحال، خودمختاری، هدفمندی و مسئولیتپذیری سیستمهای هوش مصنوعی چالشبرانگیز است. زمانی که یک سیستم یا عامل هوش مصنوعی در یک کار مشخص شکست میخورد و به عواقب بدی منجر میشود، چه کسی باید پاسخگو باشد [18].

در مورد عواقب نامطلوب احتمالی که توسط هوش مصنوعی ایجاد میشود، مانند اشتباه در کدهای برنامهنویسی، دادههای ورودی غلط، عملکرد نامناسب یا عوامل دیگر، چه کسی پاسخگو خواهد بود. بنابراین، پاسخگویی یک موضوع اخلاقی است که به عوامل انسانی دخیل در طراحی، پیادهسازی، استقرار و استفاده از هوش مصنوعی مربوط میشود [19].

هدف نهایی رعایت نکات اخلاقی در هوش مصنوعی این است که بتوان از اصول اخلاقی پیروی کرد و اخلاقمدارانه رفتار کرد که بسیار دشوار است. در مطالعهای پیشنهاد شده است طراحان، مهندسان نرمافزار و سایر شرکتکنندگان در طراحی و کاربرد سیستمهای هوش مصنوعی باید قوانین حقوق بشر را رعایت کنند. در صورت کوچکترین اشتباه در کاربری، ممکن است نقض حقوق بشر صورت پذیرد که این امر نیز یکی از دوراهیهای اخلاقی است [20].

تأثیر اجتماعی مسائل اخلاقی هوش مصنوعی نیز به این صورت است که جایگزینی سیستمها و رباتهای خودکار هوش مصنوعی باعث اختلال در بهکارگیری نیروهای کادر درمان، بهویژه پرستاران، میگردد. این امر بسیاری از سیاستگذاران سلامت را با ترس روبهرو کرده است. اصل عدالت و انصاف به عدم تبعیض و بیطرفی مربوط میشود [21].

نژادپرستی و تعصب جنسیتی در بسیاری از حوادث رایج است. بیشتر این موارد در زبان یا مدلهای بینایی کامپیوتری رخ میدهد. این مورد باید یک حوزه بسیار متمرکز برای متخصصان هوش مصنوعی در حین طراحی و استقرار باشد. اصل عدم سوءاستفاده نیز بر این باور است که تعهدی وجود دارد که آسیبی به دیگران وارد نشود. این اصل به نگرانیهای ایمنی، آسیب، امنیت و حفاظت مربوط میشود. این سومین موضوع رایج در دستورالعملهای اخلاقی است [22].

فناوریهای هوش مصنوعی مزایای قابلتوجهی برای پرستاری، بهویژه در تصمیمگیری و کارایی وظایف، ارائه میدهند. بااینحال، این مزایا باید در برابر نگرانیهای اخلاقی، ازجمله حفاظت از حقوق بیمار، شفافیت الگوریتمی و کاهش سوگیری، متعادل شوند. چارچوبهای نظارتی فعلی برای برآورده کردن نیازهای اخلاقی پرستاری نیاز به سازگاری دارند [27].

باتوجهبه جدول شماره 2، بررسی مطالعات نشان داد سوگیری و تبعیض بیشترین توجه را به خود اختصاص داده و در 14 مطالعه (82 درصد) گزارش شده است. پس از آن، استقلال و خودمختاری پرستار با پوشش 13 مطالعه (76 درصد) در جایگاه دوم قرار دارد. مسئولیتپذیری و پاسخگویی نیز در 12 مطالعه (71 درصد) مورد توجه قرار گرفته است.

موضوع شفافیت الگوریتمی و تفسیرپذیری در 10 مطالعه (59 درصد) بررسی شده است. دو محور امنیت، حریم خصوصی و حقوق بشر و اصل عدم آسیب و خیرخواهی هر کدام در 9 مطالعه (53 درصد) گزارش شدهاند. عدالت و انصاف با 8 مطالعه (47 درصد) و درنهایت چارچوبهای نظارتی و حقوقی با 5 مطالعه (29 درصد) کمترین فراوانی را در میان فراوانی نسبی چالش و دوراهی های اخلاقی داشتهاند.

نتیجهگیری

نتایج مطالعه حاضر نشان میدهد چالشها و دوراهیهای اخلاقی بسیاری دررابطهبا استفاده از هوش مصنوعی در پرستاری وجود دارد و در سالهای گذشته افزایش چشمگیری داشته است. ورود هوش مصنوعی به عرصه پرستاری، اگرچه نویدبخش بهبودهایی در ارائه مراقبت است، مجموعهای جدی از پرسشها و تردیدهای اخلاقی را پیش روی پرستاران و نظام سلامت قرار میدهد که نمیتوان آنها را نادیده گرفت. یافتههای ما بهوضوح نشان میدهد این فناوری، صرفاً یک ابزار کمکی نیست، بلکه عاملی است که میتواند نحوه تصمیمگیری، تعامل و درنهایت کیفیت مراقبت ارائهشده توسط پرستاران را بهطور بنیادین تحت تأثیر قرار دهد.

بهکارگیری هوش مصنوعی در پرستاری، با وجود مزایایی مانند کمک به تشخیص، بهبود همکاری و مقرونبهصرفهتر بودن، چالشها و دوراهیهای اخلاقی متعددی را برای پرستاران ایجاد میکند. این چالشها شامل مسائلی نظیر سوگیری و تبعیض در الگوریتمها، عدم شفافیت در عملکرد آنها، تهدید استقلال پرستاران، ابهامات در مورد مسئولیتپذیری در صورت بروز خطا، و نگرانیهای مربوط به اصول اخلاقی سنتی مانند ضرر نرساندن، خیرخواهی و عدالت است.

چالشهای اخلاقی در استفاده از هوش مصنوعی در مراقبتهای پرستاری، بهویژه درمورد عدالت، استقلال، عدم ضرررسانی، سودرسانی و مسئولیتپذیری رایج هستند. مطالعاتی که استفاده از هوش مصنوعی را نیازمند حل کردن دوراهیها و چالشهای اخلاقی میدانند نیز بسیار است. پیشنهاد میشود در مطالعات آتی به بررسی دقیق و یافتن راهحلهایی برای اطمینان از اجرای اخلاقی و مسئولانه استفاده از هوش مصنوعی در مراقبتهای بهداشتی پرداخته شود.

ملاحظات اخلاقی

پیروی از اصول اخلاق پژوهش

در تدوین این مقاله مروری، کلیه اصول اخلاق پژوهش رعایت شده است. تمامی یافتهها و متون از مقالات دیگر، با استناد به منبع اصلی و مطابق با قواعد سرقت ادبی، بهطور مناسب ذکر شدهاند. از آنجاییکه این مطالعه مبتنی بر دادههای منتشرشده قبلی است، با کسب مجوز از کمیته اخلاق دانشگاه علوم پزشکی اردبیل با شناسه اخلاق (IR.ARUMS.REC.1404.114.) انجام شد.

حامی مالی

این پژوهش هیچگونه کمک مالی از سازمانیهای دولتی، خصوصی و غیرانتفاعی دریافت نکرده است.

مشارکت نویسندگان

مفهومسازی: مژده طاهری افشار؛ روششناسی: مژده طاهری افشار و مصطفی رجبزاده؛ اعتبارسنجی و نظارت: محسن پورصادقی؛ تحلیل و منابع: امیرحسین نادی؛ تحقیق و بررسی: ملیحه اسحاقزاده؛ نگارش پیشنویس و بصریسازی: مصطفی رجبزاده؛ ویراستاری و نهاییسازی نوشته: مصطفی رجبزاده و محسن پورصادقی؛ مدیریت پروژه: محسن پورصادقی و ملیحه اسحاقزاده.

تعارض منافع

بنابر اظهار نویسندگان، این مقاله تعارض منافع ندارد.

References

- Seibert K, Domhoff D, Bruch D, Schulte-Althoff M, Fürstenau D, Biessmann F, et al. Application scenarios for artificial intelligence in nursing care: Rapid review. Journal of Medical Internet Research. 2021; 23(11):e26522. [DOI:10.2196/26522] [PMID]

- Esmali R, Akhlaghi Pirposhteh E, Askari A, Poursadeghiyan M. An overview of the applications and conditions for using artificial intelligence and digitalization in occupational health and safety in the workplace. Journal of Health and Safety at Work. 2025; 15(3):724-46. [Link]

- Ronquillo CE, Peltonen LM, Pruinelli L, Chu CH, Bakken S, Beduschi A, et al. Artificial intelligence in nursing: Priorities and opportunities from an international invitational think-tank of the Nursing and artificial intelligence leadership collaborative. Journal of Advanced Nursing. 2021; 77(9):3707-17. [DOI:10.1111/jan.14855] [PMID]

- De Gagne JC. The state of artificial intelligence in nursing education: past, present, and future directions. International Journal of Environmental Research and Public Health. 2023; 20(6):4884. [DOI:10.3390/ijerph20064884] [PMID]

- Ross A, Freeman R, McGrow K, Kagan O. Implications of artificial intelligence for nurse managers. Nursing Management. 2024; 55(7):14-23. [DOI:10.1097/nmg.0000000000000143] [PMID]

- Buchanan C, Howitt ML, Wilson R, Booth RG, Risling T, Bamford M. Predicted influences of artificial intelligence on nursing education: Scoping review. JMIR Nursing. 2021; 4(1):e23933. [DOI:10.2196/23933] [PMID]

- McGreevey JD 3rd, Hanson CW 3rd, Koppel R. Clinical, legal, and ethical aspects of artificial intelligence-assisted conversational agents in health care. JAMA. 2020; 324(6):552-3. [DOI:10.1001/jama.2020.2724] [PMID]

- Naik N, Hameed BMZ, Shetty DK, Swain D, Shah M, Paul R, et al. Legal and ethical consideration in artificial intelligence in healthcare: Who takes responsibility? Frontiers in Surgery. 2022; 9:862322. [DOI:10.3389/fsurg.2022.862322] [PMID]

- Arnold MH. Teasing out artificial intelligence in medicine: an ethical critique of artificial intelligence and machine learning in medicine. Journal of Bioethical Inquiry. 2021; 18(1):121-39. [DOI:10.1007/s11673-020-10080-1] [PMID]

- Tam W, Huynh T, Tang A, Luong S, Khatri Y, Zhou W. Nursing education in the age of artificial intelligence powered Chatbots (AI-Chatbots): Are we ready yet? Nurse Education Today. 2023; 129:105917. [DOI:10.1016/j.nedt.2023.105917] [PMID]

- Belk R. Ethical issues in service robotics and artificial intelligence. The Service Industries Journal. 2020; 41:1-17. [DOI:10.1080/02642069.2020.1727892]

- Karimian G, Petelos E, Evers S. The ethical issues of the application of artificial intelligence in healthcare: a systematic scoping review. AI and Ethics. 2022; 2:1-13. [DOI:10.1007/s43681-021-00131-7]

- Rubeis G. The disruptive power of Artificial Intelligence. Ethical aspects of gerontechnology in elderly care. Archives of Gerontology and Geriatrics. 2020; 91:104186. [DOI:10.1016/j.archger.2020.104186] [PMID]

- Saheb T, Saheb T, Carpenter DO. Mapping research strands of ethics of artificial intelligence in healthcare: A bibliometric and content analysis. Computers in Biology and Medicine. 2021; 135:104660. [DOI:10.1016/j.compbiomed.2021.104660] [PMID]

- Ibuki T, Ibuki A, Nakazawa E. Possibilities and ethical issues of entrusting nursing tasks to robots and artificial intelligence. Nursing Ethics. 2024; 31(6):1010-20. [DOI:10.1177/09697330221149094] [PMID]

- Ashok M, Madan R, Joha A, Sivarajah U. Ethical framework for Artificial Intelligence and Digital technologies. International Journal of Information Management. 2022; 62:102433. [DOI:10.1016/j.ijinfomgt.2021.102433]

- Baum SD. Social choice ethics in artificial intelligence. Ai & Society. 2020; 35(1):165-76. [DOI:10.1007/s00146-017-0760-1]

- Brendel AB, Mirbabaie M, Lembcke TB, Hofeditz L. Ethical management of artificial intelligence. Sustainability. 2021; 13(4):1974. [DOI:10.3390/su13041974]

- Ma L, Zhang Z, Zhang N. Ethical dilemma of artificial intelligence and its research progress. IOP Conference Series: Materials Science and Engineering. 2018; 392:062188. [DOI:10.1088/1757-899X/392/6/062188]

- Jabotinsky HY, Sarel R. Co-authoring with an AI? Ethical dilemmas and artificial intelligence. Arizona State Law Journal, Forthcoming. 2024; 56:187. [DOI:10.2139/ssrn.4303959]

- Denning PJ, Denning DE. Dilemmas of artificial intelligence. Communications of the ACM. 2020; 63(3):22-4. [DOI:10.1145/3379920]

- Strümke I, Slavkovik M, Madai VI. The social dilemma in artificial intelligence development and why we have to solve it. AI and Ethics. 2022; 2(4):655-65. [DOI:10.1007/s43681-021-00120-w]

- Abdolahi Shahvali E, Arizavi Z, Hematipour ه, Jahangirimehr A. Investigating the level of knowledge, attitude and performance students regarding the applications of artificial intelligence in nursing. Jundishapur Scientific Medical Journal. 2024; 23(2):134-42. [DOI:10.32592/JSMJ.23.2.134]

- Eskandari S. Ethical challenges of using artificial intelligence in article writing. Education and Ethics In Nursing ISSN. 2024; 13(1-2):4-6. [DOI:10.22034/ethic.2024.2029584.1051]

- Rony MKK, Akter K, Debnath M, Rahman M, Johra F, Akter F, et al. Strengths, weaknesses, opportunities and threats (SWOT) analysis of artificial intelligence adoption in nursing care. Journal of Medicine, Surgery, and Public Health. 2024; 3:100113. [DOI:10.1016/j.glmedi.2024.100113]

- Sisk BA, Antes AL, DuBois JM. An overarching framework for the ethics of artificial intelligence in pediatrics. JAMA Pediatrics. 2024; 178(3):213-4. [DOI:10.1001/jamapediatrics.2023.5761] [PMID]

- Mohammed SAAQ, Osman YMM, Ibrahim AM, Shaban M. Ethical and regulatory considerations in the use of AI and machine learning in nursing: A systematic review. International Nursing Review. 2025; 72(1):e70010. [DOI:10.1111/inr.70010] [PMID]

- Badawy W, Zinhom H, Shaban M. Navigating ethical considerations in the use of artificial intelligence for patient care: A systematic review. International Nursing Review. 2025; 72(3):e13059. [DOI:10.1111/inr.13059] [PMID]

- Huang C, Zhang Z, Mao B, Yao X. An overview of artificial intelligence ethics. IEEE Transactions on Artificial Intelligence. 2022; 4:799-819. [DOI:10.1109/TAI.2022.3194503]

- Stock-Homburg R, Kegel M. Ethical Considerations in Customer-Robot Service Interactions: Scoping review, network analysis, and future research Agenda. International Journal of Social Robotics. 2025; 17:1129-59. [DOI:10.1007/s12369-025-01239-0]

ارسال پیام به نویسنده مسئول

| بازنشر اطلاعات | |

|

این مقاله تحت شرایط Creative Commons Attribution-NonCommercial 4.0 International License قابل بازنشر است. |